Depuis quelque temps, nous sommes bombardés de discours, d’émissions, d’articles, d’études, de débats, de colloques, concernant l’IA. Cela n’est guère étonnant, compte tenu de la révolution que nous sommes en train de vivre. Mais ce qui l’est davantage, c’est que l’intégralité des propos tenus sur l’IA, des plus enthousiastes aux plus sceptiques, reposent sur un même présupposé : celui de la neutralité de cet outil. Dire que l’IA est neutre signifie que nous pouvons en retenir les bienfaits pour l’être humain et lutter contre ses dangers et ses perversions. À l’instar d’un couteau, que ma conscience morale m’oblige à n’utiliser que pour partager une tarte et ô grand jamais pour trucider ma belle-mère. Même les voix les plus favorables à l’IA insistent sur la vigilance, la nécessité de régulations politiques et juridiques, et l’engagement à maintenir cet outil sous notre maîtrise.

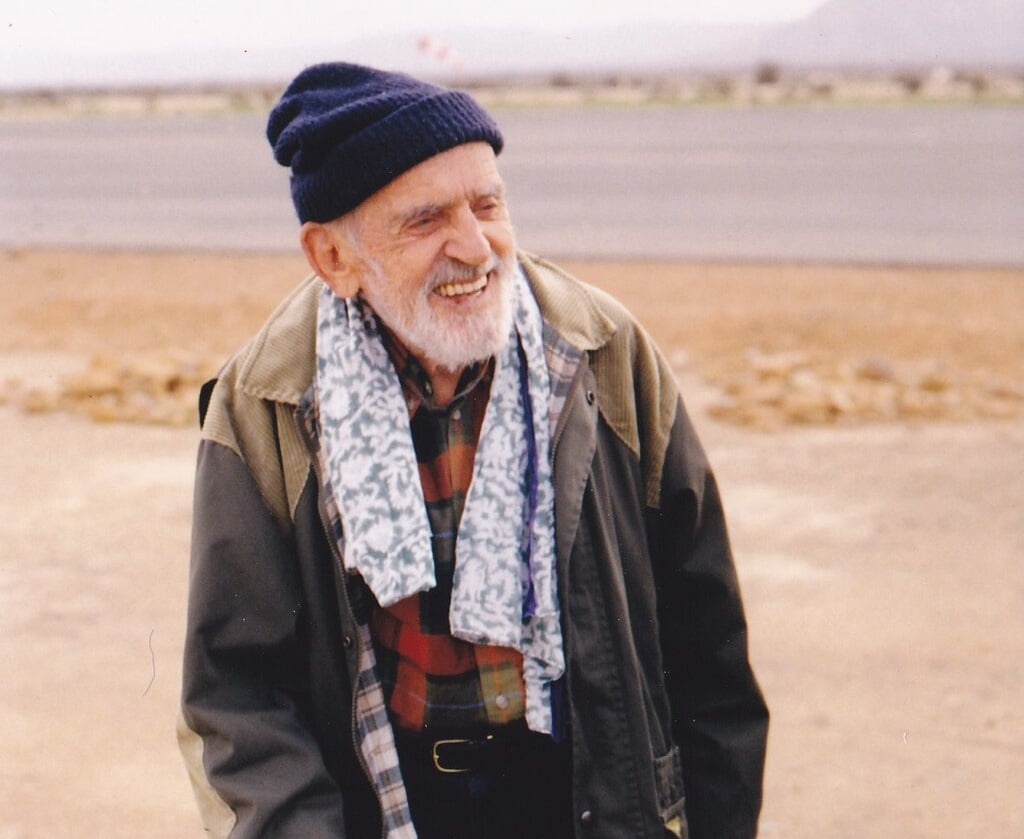

Or, l’IA n’est pas un couteau : l’appréhender en termes de neutralité relève d’un leurre tragique. Dès 1988, dans Le bluff technologique, Jacques Ellul contestait la thèse de la neutralité de l’IA, au nom de celle de son ambivalence. Neutralité et ambivalence sont deux grilles de lecture radicalement incompatibles. L’ambivalence de l’IA signifie qu’elle produira, de façon absolument indissociable, des effets positifs, favorables à la condition humaine, et des effets délétères, littéralement catastrophiques. Et que l’on ne pourra jamais avoir les uns sans les autres.

L’ambivalence de l’IA tient à deux facteurs : d’une part, à la logique même du phénomène technicien dans son exacerbation contemporaine ; d’autre part, à la nature humaine, qu’en protestantisme on observera avec la plus grande circonspection : « Je ne fais pas le bien que je veux, et je fais le mal que je ne veux pas » (Ro 7, 19).

Frédéric Rognon, professeur de philosophie pour « L’œil de Réforme »